Lineare Regressionsrechner

Führen Sie eine lineare Regressionsanalyse mit Steigung, Achsenabschnitt, R² und Vorhersageintervallen für Datensätze durch

Geben Sie gleich viele X- und Y-Werte durch Komma getrennt ein. Beide Listen müssen die gleiche Länge haben.

Regressionsgleichung

Steigung (m)

Achsenabschnitt (b)

R² (Bestimmtheitsmaß)

r (Korrelationskoeffizient)

Zusätzliche Statistiken

Anzahl der Punkte

Mittelwert von X

Mittelwert von Y

Standardfehler der Schätzung

Standardfehler der Steigung

Standardfehler des Achsenabschnitts

Vorhersage

Interpretation

Datenpunkte & Residuen

| # | X | Y (Beobachtet) | Ŷ (Vorhergesagt) | Residuum (Y - Ŷ) |

|---|

Über die lineare Regression

Die lineare Regression ist eine statistische Methode zur Modellierung der Beziehung zwischen einer abhängigen Variable (Y) und einer unabhängigen Variable (X) durch Anpassung einer Geraden an die beobachteten Daten. Die Methode der gewöhnlichen kleinsten Quadrate (OLS) findet die Gerade, die die Summe der quadrierten Abweichungen zwischen beobachteten und vorhergesagten Werten minimiert.

Die Regressionsgleichung

ŷ = mx + b

- ŷ — der vorhergesagte Wert der abhängigen Variable

- m — die Steigung (Änderungsrate von Y pro Einheitsänderung von X)

- x — der Wert der unabhängigen Variable

- b — der Y-Achsenabschnitt (Wert von Y wenn X = 0)

Wichtige Statistiken erklärt

- R² (Bestimmtheitsmaß): Misst den Anteil der Varianz in Y, der durch X erklärt wird. Reicht von 0 bis 1, wobei 1 eine perfekte Anpassung anzeigt.

- r (Korrelationskoeffizient): Misst die Stärke und Richtung der linearen Beziehung zwischen X und Y. Reicht von -1 bis +1.

- Standardfehler der Schätzung: Misst die durchschnittliche Entfernung, die die beobachteten Werte von der Regressionslinie abweichen.

- Residuen: Die Differenzen zwischen den beobachteten Y-Werten und den vorhergesagten Ŷ-Werten. In einem guten Modell sollten die Residuen zufällig um Null verteilt erscheinen.

Wie Steigung und Achsenabschnitt berechnet werden

- Steigung (m): m = Σ[(xᵢ - x̄)(yᵢ - ȳ)] / Σ[(xᵢ - x̄)²]

- Achsenabschnitt (b): b = ȳ - m · x̄

- R²: R² = 1 - (SS_res / SS_tot), wobei SS_res = Σ(yᵢ - ŷᵢ)² und SS_tot = Σ(yᵢ - ȳ)²

Interpretation der R²-Werte

Starke Anpassung (R² > 0,7)

Das Modell erklärt einen großen Anteil der Varianz in Y. Die lineare Beziehung ist eine gute Beschreibung der Daten.

Moderate Anpassung (0,4 ≤ R² ≤ 0,7)

Ein Teil der Varianz wird erklärt, aber andere Faktoren oder ein nichtlineares Modell können eine bessere Anpassung liefern.

Schwache Anpassung (R² < 0,4)

Das lineare Modell erklärt nicht viel der Varianz. Erwägen Sie andere Variablen oder einen anderen Modelltyp.

Perfekte Anpassung (R² = 1)

Alle Datenpunkte liegen genau auf der Regressionslinie. Dies ist bei realen Daten selten und kann auf Überanpassung hindeuten.

Annahmen der linearen Regression

- Linearität: Die Beziehung zwischen X und Y ist linear

- Unabhängigkeit: Die Beobachtungen sind voneinander unabhängig

- Homoskedastizität: Die Varianz der Residuen ist über alle Stufen von X konstant

- Normalität: Die Residuen sind annähernd normalverteilt (wichtig für Inferenz)

Häufige Anwendungen

Wirtschaft & Ökonomie

- • Umsatzprognose aus Werbeausgaben

- • Umsatzvorhersage basierend auf Marktgröße

- • Schätzung von Kostenfunktionen

- • Angebot- und Nachfragemodellierung

Wissenschaft & Technik

- • Kalibrierkurven in der Chemie

- • Dosis-Wirkungs-Beziehungen

- • Validierung physikalischer Gesetze

- • Umwelttrendanalyse

Sozialwissenschaften

- • Bildungsergebnisse vs. Lernstunden

- • Gesundheitskennzahlen und Lebensstilfaktoren

- • Bevölkerungswachstumstrends

- • Umfragedatenanalyse

Referenzen

Die in diesem Rechner verwendeten Formeln und Methoden basieren auf etablierter statistischer Theorie aus folgenden Quellen:

- NIST/SEMATECH e-Handbook of Statistical Methods — Lineare Kleinste-Quadrate-Regression

- Yale University, Fachbereich Statistik — Lineare Regression

- Penn State STAT 501 — Einfache lineare Regression

- Khan Academy — Überblick zur linearen Regression

- Freedman, D., Pisani, R., & Purves, R. (2007). Statistics (4. Aufl.). W.W. Norton & Company.

- Montgomery, D. C., Peck, E. A., & Vining, G. G. (2012). Introduction to Linear Regression Analysis (5. Aufl.). Wiley.

Hinweis: Dieser Rechner verwendet die Methode der gewöhnlichen kleinsten Quadrate (OLS) für einfache lineare Regression. Die Ergebnisse sind für lineare Beziehungen gültig. Für nichtlineare Daten sollten polynomiale oder andere Regressionsmodelle in Betracht gezogen werden. Überprüfen Sie immer, ob die Annahmen der linearen Regression erfüllt sind, bevor Sie Schlussfolgerungen ziehen.

Recommended Calculator

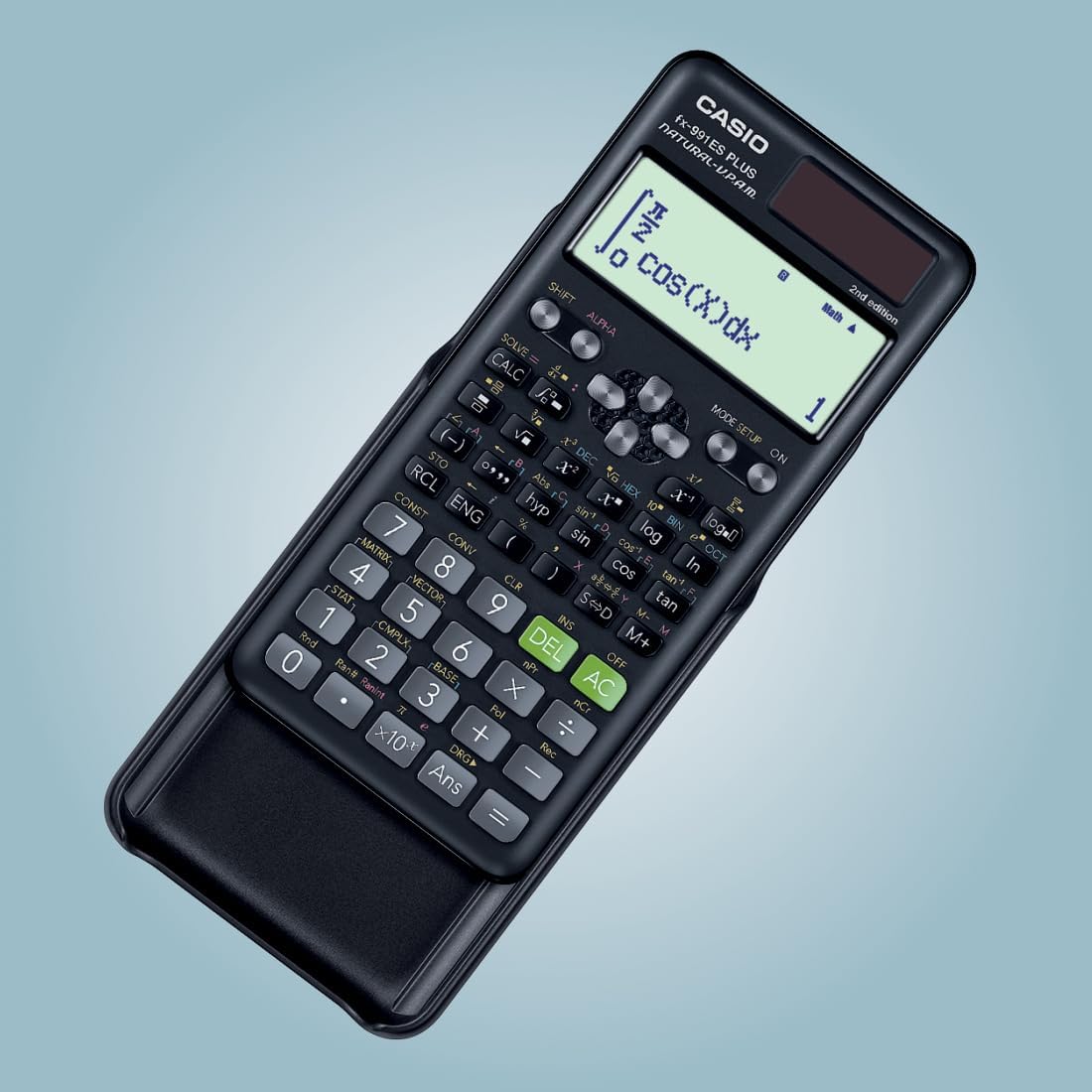

Casio FX-991ES Plus

The professional-grade scientific calculator with 417 functions, natural display, and solar power. Perfect for students and professionals.

View on Amazon