Calculateur de Régression Linéaire

Effectuez une analyse de régression linéaire avec pente, ordonnée à l’origine, R² et intervalles de prédiction pour des ensembles de données

Entrez un nombre égal de valeurs X et Y séparées par des virgules. Les deux listes doivent avoir la même longueur.

Équation de Régression

Pente (m)

Ordonnée à l’origine (b)

R² (Coefficient de Détermination)

r (Coefficient de Corrélation)

Statistiques Supplémentaires

Nombre de Points

Moyenne de X

Moyenne de Y

Erreur Standard de l’Estimation

Erreur Standard de la Pente

Erreur Standard de l’Ordonnée

Prédiction

Interprétation

Points de Données & Résidus

| # | X | Y (Observé) | Ŷ (Prédit) | Résidu (Y - Ŷ) |

|---|

À Propos de la Régression Linéaire

La régression linéaire est une méthode statistique utilisée pour modéliser la relation entre une variable dépendante (Y) et une variable indépendante (X) en ajustant une droite aux données observées. La méthode des moindres carrés ordinaires (MCO) trouve la droite qui minimise la somme des carrés des différences entre les valeurs observées et prédites.

L’Équation de Régression

ŷ = mx + b

- ŷ — la valeur prédite de la variable dépendante

- m — la pente (taux de variation de Y par unité de X)

- x — la valeur de la variable indépendante

- b — l’ordonnée à l’origine (valeur de Y quand X = 0)

Statistiques Clés Expliquées

- R² (Coefficient de Détermination) : Mesure la proportion de la variance de Y expliquée par X. Varie de 0 à 1, où 1 indique un ajustement parfait.

- r (Coefficient de Corrélation) : Mesure la force et la direction de la relation linéaire entre X et Y. Varie de -1 à +1.

- Erreur Standard de l’Estimation : Mesure la distance moyenne entre les valeurs observées et la droite de régression.

- Résidus : Les différences entre les valeurs Y observées et les valeurs Ŷ prédites. Dans un bon modèle, les résidus doivent apparaître dispersés aléatoirement autour de zéro.

Comment la Pente et l’Ordonnée Sont Calculées

- Pente (m) : m = Σ[(xᵢ - x̄)(yᵢ - ȳ)] / Σ[(xᵢ - x̄)²]

- Ordonnée (b) : b = ȳ - m · x̄

- R² : R² = 1 - (SS_res / SS_tot), où SS_res = Σ(yᵢ - ŷᵢ)² et SS_tot = Σ(yᵢ - ȳ)²

Interprétation des Valeurs de R²

Ajustement Fort (R² > 0,7)

Le modèle explique une grande proportion de la variance de Y. La relation linéaire est une bonne description des données.

Ajustement Modéré (0,4 ≤ R² ≤ 0,7)

Une partie de la variance est expliquée, mais d’autres facteurs ou un modèle non linéaire pourraient offrir un meilleur ajustement.

Ajustement Faible (R² < 0,4)

Le modèle linéaire n’explique pas beaucoup de la variance. Envisagez d’autres variables ou un type de modèle différent.

Ajustement Parfait (R² = 1)

Tous les points de données se trouvent exactement sur la droite de régression. C’est rare avec des données réelles et peut indiquer un surajustement.

Hypothèses de la Régression Linéaire

- Linéarité : La relation entre X et Y est linéaire

- Indépendance : Les observations sont indépendantes les unes des autres

- Homoscédasticité : La variance des résidus est constante à tous les niveaux de X

- Normalité : Les résidus suivent approximativement une distribution normale (important pour l’inférence)

Applications Courantes

Affaires & Économie

- • Prévision des ventes à partir des dépenses publicitaires

- • Prédiction des revenus basée sur la taille du marché

- • Estimation des fonctions de coût

- • Modélisation de l’offre et de la demande

Sciences & Ingénierie

- • Courbes d’étalonnage en chimie

- • Relations dose-réponse

- • Validation des lois physiques

- • Analyse des tendances environnementales

Sciences Sociales

- • Résultats scolaires vs. heures d’étude

- • Indicateurs de santé et facteurs de mode de vie

- • Tendances de croissance démographique

- • Analyse de données d’enquête

Références

Les formules et la méthodologie utilisées dans ce calculateur sont basées sur la théorie statistique établie provenant des sources suivantes :

- NIST/SEMATECH e-Handbook of Statistical Methods — Linear Least Squares Regression

- Yale University Department of Statistics — Linear Regression

- Penn State STAT 501 — Simple Linear Regression

- Khan Academy — Linear Regression Review

- Freedman, D., Pisani, R., & Purves, R. (2007). Statistics (4th ed.). W.W. Norton & Company.

- Montgomery, D. C., Peck, E. A., & Vining, G. G. (2012). Introduction to Linear Regression Analysis (5th ed.). Wiley.

Remarque : Ce calculateur utilise la méthode des moindres carrés ordinaires (MCO) pour la régression linéaire simple. Les résultats sont valides pour les relations linéaires. Pour des données non linéaires, envisagez des modèles de régression polynomiale ou autres. Vérifiez toujours que les hypothèses de la régression linéaire sont respectées avant de tirer des conclusions.

Recommended Calculator

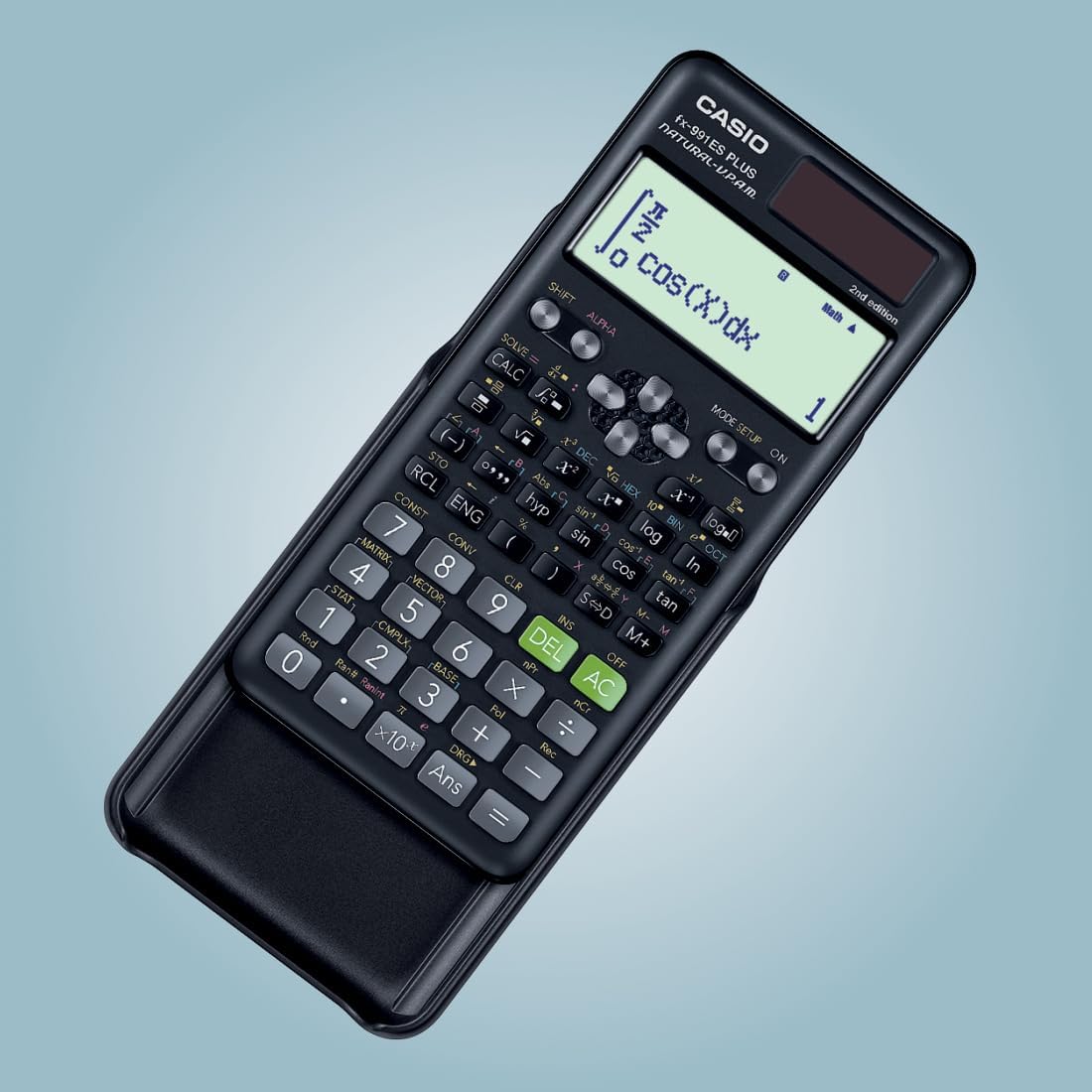

Casio FX-991ES Plus

The professional-grade scientific calculator with 417 functions, natural display, and solar power. Perfect for students and professionals.

View on Amazon